Az önvezető autók mellett a biológiai kutatásoktól az orvosi képalkotásig sok területen hasznosíthatják majd Mohos Bálint és Halmosi Levente felfedezését. A Szegedi Tudományegyetem Interdiszciplináris Kutatásfejlesztési és Innovációs Kiválósági Központ Mesterséges Intelligencia Kompetenciaközpont kutatói a rangos European Conference on Computer Vision (ECCV) konferencián ismertették a képszegmentálás témakörében született, hiánypótló tudományos cikküket.

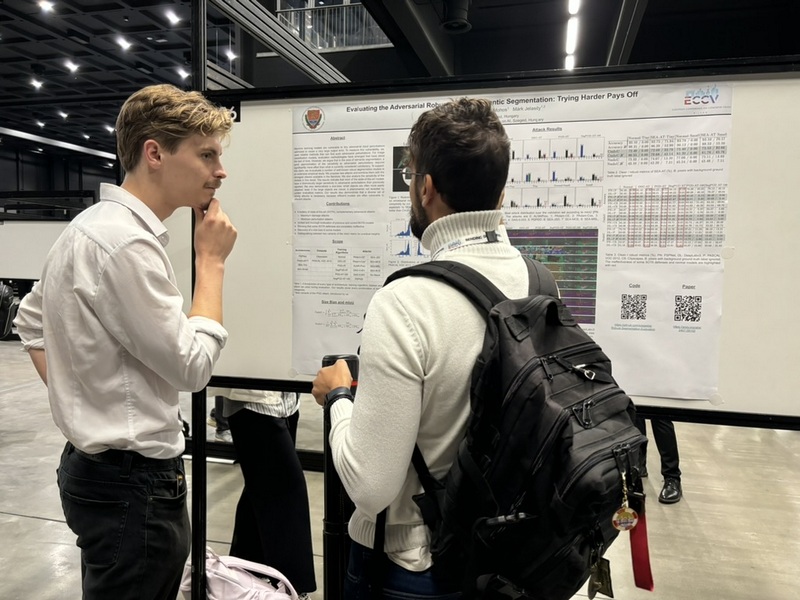

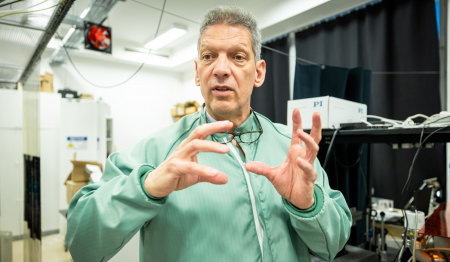

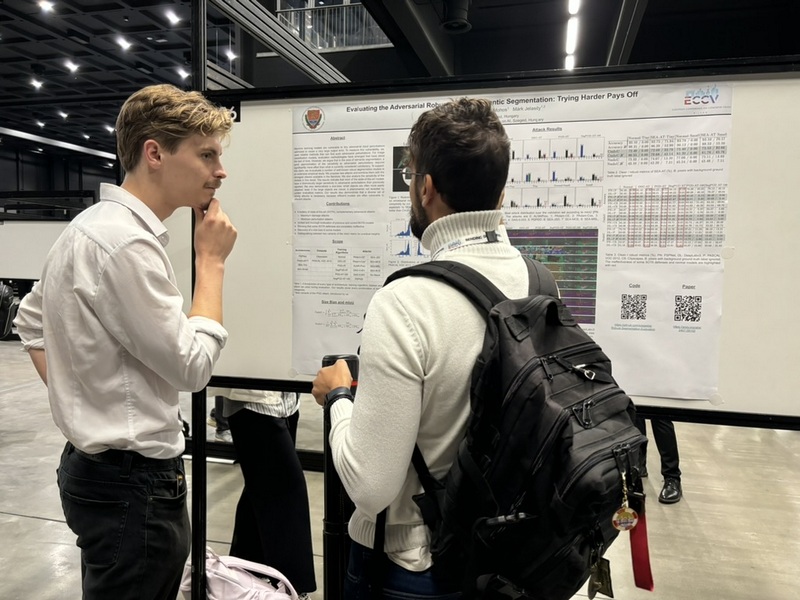

- A mesterséges intelligencia területén a nemzetközi kutatói közösség első számú fórumai nem folyóiratok, hanem azok a kiemelt konferenciák, amelyek az úgynevezett ICORE Conference Ranking besorolása alapján A* kategóriájúak. Ilyen eseményhez kapcsolódóan az SZTE eddigi története során 30 publikáció született. Országos szinten ezzel a Tisza-parti intézmény élvonalban szerepel – tudtuk meg Dr. Jelasity Márktól. Az SZTE IKIKK Mesterséges Intelligencia Kompetenciaközpont szakmai vezetője elmondta: az október végén megrendezett European Conference on Computer Vision (ECCV) is egy ilyen kiemelt konferencia, amely a számítógépes látás egyik legfontosabb fóruma. A részvétel nem automatikus, a benyújtott munkák körülbelül negyedét fogadják el közlésre, a színvonallal kapcsolatos elvárások nagyon magasak. A konferencián jellemzően a számítógépes képfeldolgozással, gépi látással kapcsolatos témák kerülnek szóba, az utóbbi időben jelentős fókusszal a mesterséges intelligencia, gépi tanulás és a mély neuronhálók módszerekre.

- Az általunk bemutatott cikk témája a képszegmentáló neuronhálózatok érzékenysége az ellenséges támadásokra. Láthatatlan, jól megtervezett zaj hozzáadásával ugyanis egy képen található objektumok azonosítása teljesen elrontható a mesterséges intelligencia számára, míg az emberi megfigyelő nem érzékel a képen változást. A munkánkban azt mutatjuk meg, hogy szemben a szakirodalomban közölt állításokkal, valójában egyetlen ismert módszer sem hatásos az ilyen támadásokkal szembeni védekezésre. Ezt a korábbi támadási módszerek továbbfejlesztésével és kombinálásával bizonyítottuk – magyarázta Halmosi Levente, a cikk első szerzője, aki a publikáció írásakor mindössze másodéves BSc hallgató volt.

- A témaválasztás alapvetően abból fakadt, hogy a Szegedi Mesterséges Intelligencia Kutatócsoport profiljában mindig is fontos szerepet játszott a rendszerek hibakezelési képességének kérdése, illetve az AI alkalmazások biztonságossága. Ezek olyan területek, amelyek iránt a kutatócsoport régóta elkötelezett, hiszen az AI fejlődésével a rendszerek megbízhatósága és védhetősége egyre nagyobb jelentőséget nyer. A motivációm egyik fő forrása, hogy a szegmentálás és annak biztonságos alkalmazása a mai napig viszonylag alulkutatott területnek számít, ugyanakkor a szemantikus szegmentálást egyre gyakrabban használják olyan kritikus rendszerekben, ahol a pontosság és a megbízhatóság kulcsfontosságú – mondta Halmosi Levente. Hozzátette: a szemantikus képszegmentálás azt jelenti, hogy egy képen, például egy utcaképen, minden egyes pontra meghatározzák a kutatók, hogy az adott pont milyen objektumhoz tartozik (ember, autó, ház, út stb.) vagyis előre adott objektumokra osztják.

Mohos Bálinttól megtudtuk: a szemantikus szegmentálásra épülő alkalmazások számos olyan területen elterjedtek, amelyek fokozott biztonsági igényeket támasztanak. A támadások mögött általában kutatási vagy fejlesztési célú motiváció áll. Több tudományos publikációban is tárgyalják az AI rendszerek támadhatóságát. A legnagyobb figyelmet Francesco Croce és Matthias Hein kutatómunkái kapták, akik a gépi tanulási modellek sebezhetőségére fókuszáltak, és számos támadási módszert dolgoztak ki. Ezek célja, hogy az ilyen modelleket megtévesszék vagy félrevezessék. Az AI rendszerekben rejlő támadási lehetőségek feltárása főként azért lényeges, mert megmutatják, hogyan lehet védekezni ellenük, és hogyan érhető el nagyobb stabilitás és biztonság az alkalmazásokban.

- A felfedezéseink széles körben alkalmazhatóak, és potenciálisan komoly hatással lehetnek több iparágra is. Az önvezető autók területén a stabilitás és megbízhatóság növelésével elérhető, hogy ezek a rendszerek biztonságosabbá váljanak, csökkentve ezzel a balesetek és a váratlan helyzetek kockázatát. Emellett a biológiai kutatásokban és az orvosi képalkotásban - ahol a pontos és robusztus képfeldolgozás kritikus fontosságú - a technológiánk segíthet a pontosabb diagnózisok és kutatási eredmények elérésében. A számítógépes látás és a neurális hálókon alapuló képalakítás további területei szintén hasznát vehetik a fejlesztéseinknek, hiszen a robusztusabb szegmentálási eljárások révén ezek az alkalmazások sokkal ellenállóbbá válhatnak a külső támadásokkal és zavaró hatásokkal szemben – összegezte Halmos Levente.

IKIKKinfo